Knowledge: Thách thức và giới hạn của Agentic AI

Thách thức và giới hạn của Agentic AI

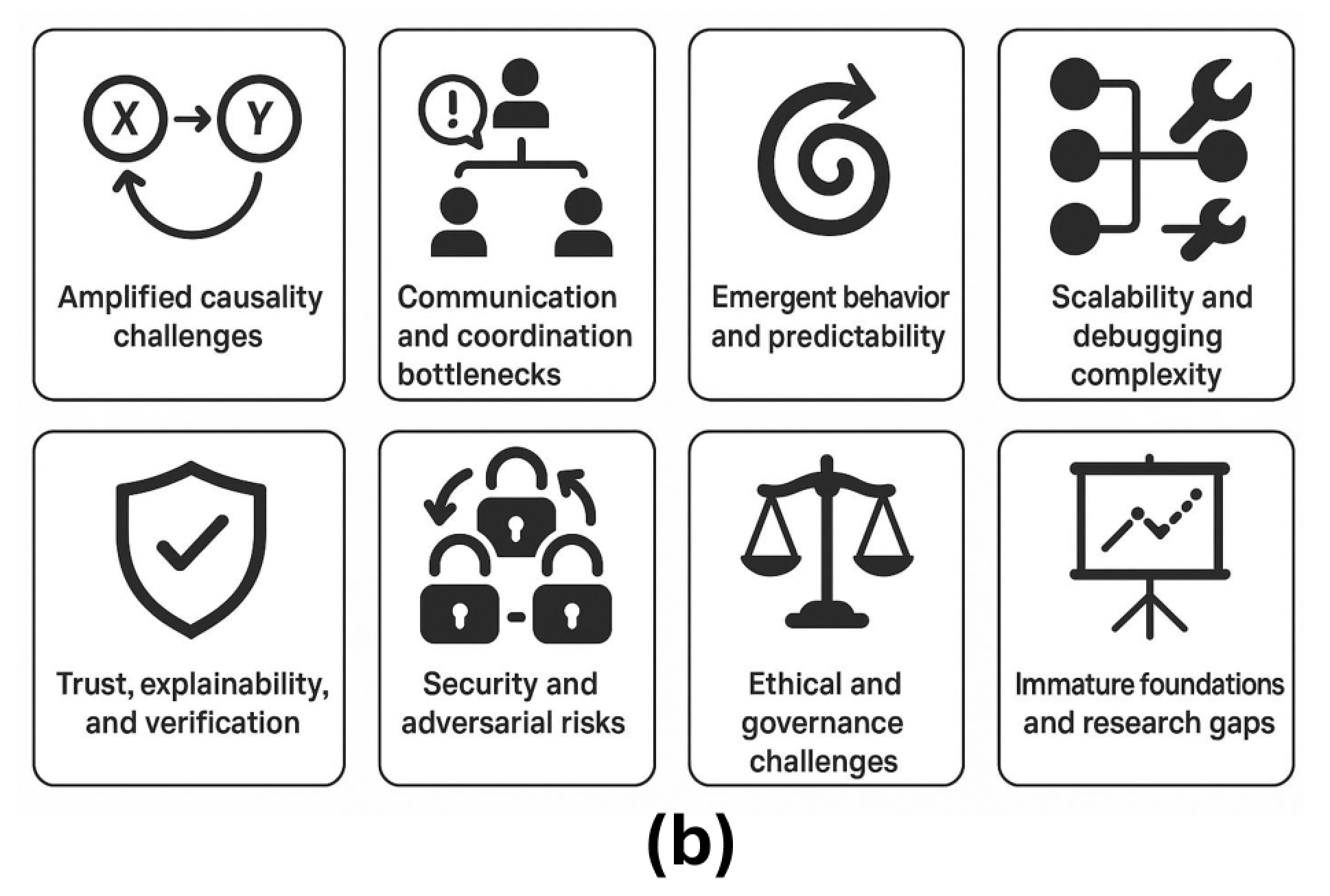

Agentic AI đánh dấu bước tiến quan trọng từ hệ thống agent đơn lẻ sang hệ sinh thái nhiều agent phối hợp, nhằm thực hiện các mục tiêu phức tạp. Tuy nhiên, chính sự tiến hóa này cũng làm phát sinh nhiều thách thức mới — cả về kỹ thuật lẫn đạo đức, bảo mật và khả năng kiểm soát hệ thống.

| # | Thách thức | Mô tả |

|---|---|---|

| 1 | 🔗 Thách thức về nhân quả (Causality)  |

- Các hệ thống Agentic AI làm trầm trọng thêm vấn đề thiếu khả năng suy luận nhân quả. - Một hành động của agent này có thể ảnh hưởng đến hành vi của agent khác, nhưng nếu không có khả năng suy luận nguyên nhân - kết quả, toàn hệ thống dễ rơi vào lỗi dây chuyền (error cascade). - Ví dụ: agent kiểm chứng xác nhận thông tin sai → các agent sau tiếp tục xử lý thông tin sai → kết quả cuối cùng sai lệch hoàn toàn. |

| 2 | 🔄 Nút thắt trong giao tiếp & điều phối  |

- Các agent cần chia sẻ mục tiêu và bối cảnh, nhưng hiện nay hệ thống chưa hỗ trợ tốt việc đồng bộ ngữ cảnh. - Giao tiếp chủ yếu qua ngôn ngữ tự nhiên → dễ gây hiểu lầm, sai lệch ngữ nghĩa. - Tranh chấp tài nguyên (CPU, API, bộ nhớ) giữa các agent cũng là một vấn đề chưa được xử lý hiệu quả. |

| 3 | 🔮 Hành vi nổi lên & tính khó dự đoán  |

- Khi nhiều agent tương tác, có thể xuất hiện các hành vi không được lập trình trước — gọi là “hành vi nổi lên” (emergent behavior). - Những hành vi này có thể thích nghi tốt, nhưng cũng có thể gây ra lỗi, mâu thuẫn hoặc hành động nguy hiểm, đặc biệt trong các lĩnh vực nhạy cảm như y tế, tài chính. |

| 4 | 🧩 Khó mở rộng và gỡ lỗi  |

- Khi số lượng agent tăng, việc truy vết nguyên nhân lỗi trở nên rất khó do chuỗi logic ẩn, lồng nhau, và biến đổi liên tục. - Thêm agent không đồng nghĩa với thông minh hơn — nếu điều phối kém, dễ gây nhiễu, mâu thuẫn và giảm hiệu quả. - Cần framework hỗ trợ trace, role rõ ràng và giao tiếp chuẩn. |

| 5 | 🕵️ Giải thích & xác minh khó khăn  |

- Mỗi agent có logic riêng, bộ nhớ riêng → rất khó xác định vì sao hệ thống ra quyết định A thay vì B. - Thiếu log tổng hợp và không có phương pháp xác minh (verification) cho toàn bộ hệ thống. - Điều này là rào cản lớn khi áp dụng vào các hệ thống yêu cầu độ tin cậy cao. |

| 6 | 🛡️ Lỗ hổng bảo mật và tấn công  |

- Một agent bị chiếm quyền (ví dụ: qua prompt injection) có thể gây ảnh hưởng toàn bộ hệ thống. - Các hình thức tấn công có thể bao gồm: chiếm dụng tài nguyên, gây deadlock, phát tán thông tin sai lệch… - Hiện vẫn chưa có chuẩn bảo mật rõ ràng cho hệ thống đa agent. |

| 7 | ⚖️ Đạo đức & quản trị  |

- Rất khó xác định trách nhiệm khi nhiều agent cùng tạo ra một kết quả. - Các thiên kiến từ dữ liệu huấn luyện của từng agent có thể cộng dồn và làm sai lệch kết quả hệ thống. - Không có cơ chế chia sẻ giá trị chung → dễ xảy ra tình trạng “lệch chuẩn đạo đức”. |

| 8 | 📏 Thiếu nền tảng lý thuyết & chuẩn hóa  |

- Chưa có kiến trúc chuẩn cho thiết kế hệ Agentic AI → mỗi nhóm tự làm theo cách riêng → khó mở rộng hoặc tái sử dụng. - Thiếu nền tảng suy luận nhân quả → hệ thống khó tổng quát hóa ra môi trường mới, khó can thiệp hoặc điều chỉnh hành vi. - Cần thêm nghiên cứu nền tảng, benchmark chuẩn, và tích hợp causal reasoning. |

✅ Tóm tắt:

- Agentic AI mở rộng năng lực của AI agent, nhưng kèm theo:

- Nguy cơ lỗi dây chuyền

- Giao tiếp kém hiệu quả

- Tính không dự đoán được

- Khó giải thích, gỡ lỗi

- Rủi ro bảo mật cao

- Thiếu cơ chế đạo đức và kiểm soát

- Cần đầu tư nghiêm túc vào:

- Chuẩn hóa kiến trúc

- Giao thức điều phối thông minh

- Giải pháp suy luận nhân quả

- Cơ chế giám sát, trace, bảo mật đa lớp

Refer: https://arxiv.org/html/2505.10468v1#S3

Tiếp theo:

- http://mikesholic.com/knowledgeai/2025/10/12/Challenges-AI-Agent.html

- http://mikesholic.com/knowledgeai/2025/10/12/Solution-AI-Agent-Agentic.html

- http://mikesholic.com/knowledgeai/2025/10/12/LLM-based-Multi-Agents(LLM-MA).html

- http://mikesholic.com/knowledgeai/2025/10/12/AI_Agentic_Summary.html